Sommaire

L’analyse de Simone De Palma montre que les paramètres de tracking dans les liens internes ne sont pas neutres. Crawl, analytics, performance, popularité des liens… leurs effets s’accumulent à l’échelle d’un site.

Une analyse de Simone De Palma, publiée sur Search Engine Land, met en lumière les effets des paramètres de tracking dans les liens internes, souvent utilisés pour le suivi marketing.

Ces paramètres, comme les UTM ou autres chaînes de requête, peuvent sembler utiles pour l’analyse. Mais intégrés aux liens internes, ils créent plusieurs effets indésirables sur le crawl, l’indexation, la performance et la qualité des données.

Un impact direct sur le crawl

Les moteurs de recherche considèrent chaque URL avec paramètres comme une adresse distincte. Cela entraîne plusieurs conséquences :

- multiplication des versions d’une même page,

- allongement des chemins de crawl,

- exploration de contenus dupliqués,

- consommation inutile du budget de crawl.

Sur des sites volumineux, ces variations peuvent rapidement se multiplier et ralentir la découverte des pages importantes.

La canonicalisation ne résout pas le problème

L’analyse rappelle qu’une balise canonical n’agit qu’au moment de l’indexation. En pratique :

- les URL avec paramètres sont toujours explorées,

- le budget de crawl reste consommé,

- la profondeur de crawl augmente.

La canonicalisation permet d’indiquer une version préférée, mais ne réduit pas le nombre d’URL que les moteurs doivent parcourir.

Des effets sur la mesure des performances

Les paramètres de tracking peuvent aussi perturber les données analytiques. Lorsqu’un utilisateur arrive sur un site puis clique sur un lien interne avec paramètres, la session peut être réattribuée. Cela peut entraîner :

- une fragmentation de l’attribution,

- des écarts entre trafic réel et données mesurées,

- une lecture moins fiable des performances SEO.

Selon les outils utilisés, ce comportement peut varier.

Une dilution de la popularité des liens

L’analyse souligne également un effet sur les backlinks. Lorsque des URL avec paramètres sont partagées ou reprises, des liens externes peuvent pointer vers ces versions. Résultat :

- la popularité est répartie entre plusieurs variantes,

- certains signaux sont dilués,

- les moteurs peuvent considérer ces liens comme moins pertinents.

Sur le long terme, cela peut affaiblir la structure globale des liens.

Un impact sur la performance et l’accès au contenu

Les paramètres dans les URL influencent aussi la gestion du cache. Chaque URL est traitée comme une ressource distincte, ce qui peut :

- multiplier les requêtes,

- alourdir le chargement des pages,

- réduire l’efficacité du cache.

L’analyse souligne également que certains systèmes, notamment les crawlers liés à l’IA, sont sensibles à ces variations d’URL. Ces systèmes s’appuient souvent sur des versions en cache et peuvent éviter le rendu JavaScript, ce qui renforce l’importance d’URL propres et stables.

Une solution structurelle côté HTML

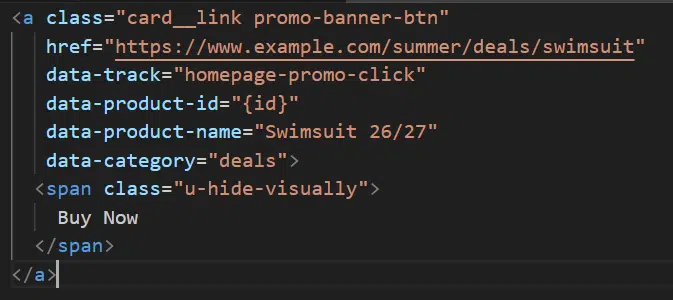

Plutôt que d’ajouter des paramètres dans les URL, l’analyse recommande de déplacer le tracking dans le code HTML. Une solution consiste à utiliser des attributs data-*, qui permettent :

- de capter les interactions utilisateurs,

- de conserver des URL propres,

- d’éviter les duplications,

- de ne pas modifier la structure des liens.

Les outils de tracking peuvent ensuite récupérer ces informations via JavaScript, sans altérer les URL.